Evoluția arhitecturilor modelelor AI și tehnologii revoluționare

Modele de arhitecturi mai eficiente

Viitorul inteligenței artificiale conversaționale este indisolubil legat de evoluția arhitecturilor modelelor AI, care trec printr-o transformare rapidă către o eficiență și performanță mai ridicate. Un aspect cheie al acestei evoluții este tehnologia Mixture-of-Experts (MoE), care reprezintă o schimbare semnificativă de la modelele monolitice la o abordare modulară. Această arhitectură împarte rețeaua neuronală în "experți" specializați, care sunt activați doar pentru tipuri specifice de intrări, ceea ce crește dramatic eficiența calculelor.

O tendință paralelă este implementarea mecanismelor de activare rară (sparse activation), care permit activarea selectivă doar a părților relevante ale modelului pentru o sarcină specifică. Spre deosebire de arhitecturile tradiționale, unde toți neuronii sunt activați, activarea rară reduce dramatic cerințele de calcul și permite construirea unor modele semnificativ mai mari, menținând în același timp un timp de inferență eficient. Consecința practică a acestor inovații este posibilitatea de a implementa chatboți AI mai sofisticați chiar și pe dispozitive edge cu capacități de calcul limitate.

Arhitecturi modulare specializate

O altă direcție de dezvoltare o reprezintă arhitecturile modulare specializate, care combină componente generice cu module specifice domeniului. Aceste sisteme integrează baze generice pre-antrenate cu module îngust specializate pentru domenii specifice precum medicina, dreptul sau finanțele, ceea ce permite atingerea unui nivel expert de cunoștințe și abilități fără a fi necesară antrenarea întregului model de la zero. Această abordare reduce semnificativ costurile de dezvoltare și, în același timp, crește acuratețea și relevanța răspunsurilor în domenii specifice.

Expansiunea înțelegerii contextuale

Evoluția arhitecturii modelelor AI se îndreaptă către o expansiune radicală a ferestrei contextuale, ceea ce reprezintă o schimbare fundamentală în capacitatea de a procesa și de a răspunde coerent la intrări complexe. Limitările actuale de ordinul zecilor sau sutelor de mii de tokenuri vor fi depășite în generațiile viitoare de modele, îndreptându-se către milioane de tokenuri sau, potențial, către un context practic nelimitat. Această expansiune va permite sistemelor conversaționale să mențină interacțiuni consistente pe termen lung și să proceseze documente extinse, cum ar fi cărți complete, lucrări de cercetare sau manuale tehnice, într-o singură trecere.

Factorii tehnologici care permit această transformare includ procesarea ierarhică a contextului, în care modelul operează cu reprezentări pe mai multe niveluri - de la nivelul local detaliat până la abstracțiuni globale. O altă abordare inovatoare este rezumarea recursivă, în care sistemul comprimă continuu informațiile istorice în reprezentări dense care păstrează informațiile cheie, minimizând în același timp cerințele de memorie. O tehnică emergentă este, de asemenea, memorarea în cache a atenției (attention caching), care optimizează calculele repetate pe părțile suprapuse ale contextului.

Gestionarea dinamică a contextului

Arhitecturile avansate implementează gestionarea dinamică a contextului, care prioritizează și selectează inteligent informațiile relevante pe baza importanței lor pentru conversația curentă. Această abordare combină strategii precum recuperarea informațiilor, cache-ul local și stocarea memoriei pe termen lung pentru a lucra eficient cu o cantitate practic nelimitată de informații contextuale. Impactul practic al acestor inovații este capacitatea asistenților AI de a oferi răspunsuri consistente și relevante din punct de vedere contextual, chiar și în cadrul interacțiunilor complexe, multi-sesiune, care se desfășoară pe o perioadă mai lungă de timp.

Abilități cognitive avansate

O tendință fundamentală în evoluția arhitecturilor AI este trecerea de la sisteme pur reactive la modele cu abilități cognitive avansate, care transformă calitativ utilitatea lor în rezolvarea problemelor complexe. Noua generație de sisteme conversaționale demonstrează un raționament cauzal semnificativ mai sofisticat - capacitatea de a identifica relații cauzale, de a distinge corelația de cauzalitate și de a construi modele mentale robuste ale domeniilor problematice. Această capacitate permite chatboților AI să ofere analize mai profunde, predicții mai precise și interpretări mai valoroase ale datelor în comparație cu generațiile anterioare.

O direcție de dezvoltare paralelă este progresul în gândirea abstractă și analogică, în care modelele pot identifica tipare de nivel înalt și pot aplica concepte dintr-un domeniu la probleme dintr-un alt domeniu. Această capacitate este crucială pentru rezolvarea creativă a problemelor, transferul interdisciplinar de cunoștințe și identificarea conexiunilor neevidente, care reprezintă adesea cea mai mare valoare în luarea deciziilor complexe. O dimensiune importantă este, de asemenea, dezvoltarea abilităților metacognitive - capacitatea modelului de a reflecta asupra propriilor procese de gândire, de a evalua calitatea răspunsurilor sale și de a identifica limitele propriilor cunoștințe.

Raționament algoritmic și rezolvarea problemelor în mai mulți pași

Arhitecturile avansate demonstrează progrese semnificative în raționamentul algoritmic și rezolvarea problemelor în mai mulți pași - capacitatea de a descompune probleme complexe într-o serie de pași parțiali, de a le rezolva sistematic și de a integra rezultatele parțiale într-o soluție coerentă. Această capacitate este esențială pentru sarcinile care necesită o abordare structurată, cum ar fi derivările matematice, planificarea complexă sau depanarea sistemelor complexe. În combinație cu o precizie sporită (capacitatea de a minimiza halucinațiile și erorile factuale), aceste capacități cognitive avansate transformă chat-urile AI din instrumente de comunicare primare în asistenți cognitivi sofisticați, capabili să ofere suport substanțial în rezolvarea problemelor reale.

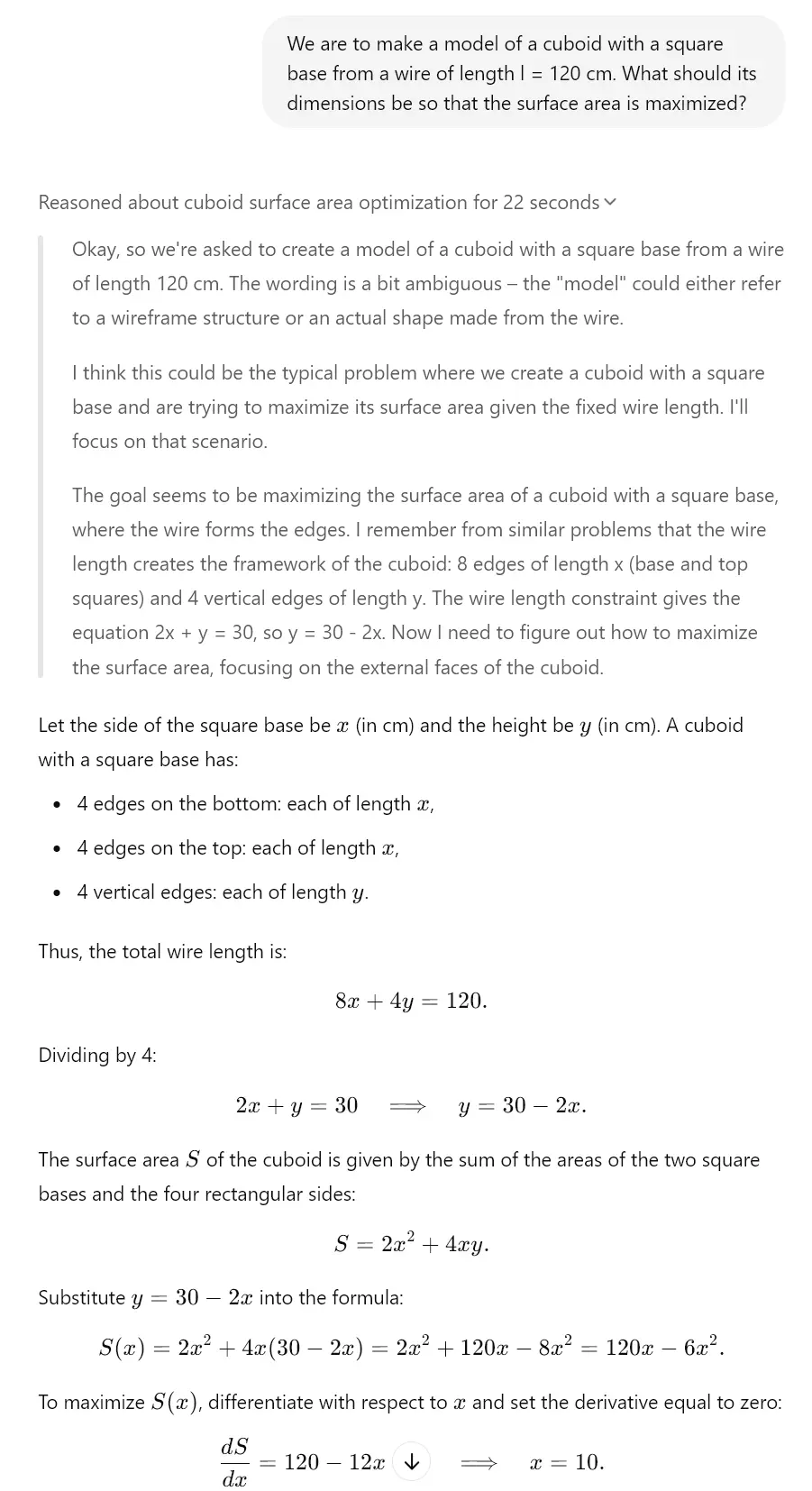

Acest lucru este vizibil în cele din urmă la modelele "gânditoare" de astăzi. De exemplu, Gemini 2.0, Claude 3.7 Sonnet sau ChatGPT o1 au aceste funcții. Uitați-vă la exemplul pe care l-am creat pentru dvs. datorită modelului o3-mini, care are un mecanism de gândire similar.

Optimizarea parametrilor și a rezultatelor

Un aspect critic al evoluției arhitecturilor AI este optimizarea continuă a parametrilor și a rezultatelor, care crește eficiența și calitatea conținutului generat. Tehnicile de cuantificare reprezintă o schimbare semnificativă în compresia modelelor și reprezintă metode de reducere a cerințelor de memorie și de calcul, menținând în același timp cea mai mare parte a performanței originale. Abordările moderne, cum ar fi cuantificarea post-antrenament și inferența cu precizie mixtă, permit reducerea dimensiunii modelelor cu până la 75%, cu o degradare minimă a performanței, ceea ce extinde dramatic spectrul de dispozitive capabile să găzduiască sisteme AI conversaționale sofisticate.

O tendință paralelă este optimizarea prin distilarea cunoștințelor, în care cunoștințele din modelele mari "profesor" sunt transferate în modele "student" mai compacte. Acest proces comprimă eficient informațiile capturate în rețele neuronale complexe în arhitecturi mai mici, care pot fi implementate în medii cu resurse limitate. Un potențial semnificativ îl reprezintă, de asemenea, optimizările specifice hardware-ului, în care arhitectura modelului este ajustată specific pentru performanță maximă pe un anumit hardware (CPU, GPU, TPU, cipuri neuromorfice), ceea ce permite atingerea unor viteze de inferență semnificativ mai mari.

Mecanisme de ieșire adaptive

Arhitecturile avansate implementează mecanisme de ieșire adaptive, care ajustează dinamic generarea răspunsurilor pe baza contextului, a cerințelor de precizie și a resurselor de calcul disponibile. Aceste sisteme echilibrează inteligent între calitate, viteză și eficiență prin tehnici precum inferența cu terminare timpurie și randarea progresivă. Consecința practică a acestor optimizări este capacitatea de a implementa asistenți AI extrem de sofisticați chiar și în scenarii de edge computing, cum ar fi mobilitatea, dispozitivele IoT sau dispozitivele purtabile pentru realitate augmentată, unde modelele lingvistice mari tradiționale sunt inutilizabile din cauza limitărilor de resurse.

Rețele neuronale și dezvoltarea lor

Un aspect fundamental al evoluției modelelor AI îl reprezintă inovația în arhitectura rețelelor neuronale, care definește capacitățile și limitele acestora. Un potențial transformator îl au arhitecturile hibride care combină diferite tipuri de rețele neuronale pentru a maximiza punctele lor forte. Aceste sisteme integrează modele bazate pe transformere optimizate pentru înțelegerea textului cu rețele convoluționale pentru analiza vizuală, rețele recurente pentru date secvențiale și rețele neuronale grafice pentru informații structurate, permițând crearea unor sisteme versatile capabile să opereze în diferite domenii și tipuri de date.

O altă direcție de dezvoltare o reprezintă transformerele recurente, care abordează limitările arhitecturilor standard de transformere în domeniul procesării secvențiale și al raționamentului temporal. Aceste modele implementează mecanisme recurente precum urmărirea stării și rafinarea iterativă, ceea ce îmbunătățește semnificativ capacitatea lor de a modela procese dinamice, raționament gradual și dependențe secvențiale complexe. Această capacitate este esențială pentru sarcini precum simularea, planificarea strategică sau predicțiile pe termen lung, care necesită o înțelegere sofisticată a relațiilor temporale.

Arhitecturi auto-modificatoare și auto-îmbunătățitoare

O tendință emergentă o reprezintă arhitecturile auto-modificatoare și auto-îmbunătățitoare, care își pot adapta structura și parametrii ca răspuns la sarcini specifice. Aceste sisteme implementează mecanisme de meta-învățare, care optimizează continuu configurația lor internă pe baza buclelor de feedback și a metricilor de performanță. O dimensiune cheie este, de asemenea, căutarea arhitecturii neuronale (NAS), în care sistemele AI proiectează și optimizează automat noi arhitecturi de rețele neuronale adaptate specific cazurilor de utilizare concrete. Această abordare accelerează iterația modelelor AI și permite crearea unor arhitecturi personalizate extrem de eficiente pentru domenii specifice de aplicare ale AI conversaționale.

Impactul evoluției asupra AI conversaționale

Impactul general al evoluției arhitecturilor AI asupra sistemelor conversaționale este transformator, aducând o schimbare fundamentală în capacitățile și potențialul lor de aplicare. Integrarea multimodală reprezintă un element cheie al acestei transformări - arhitecturile moderne permit o tranziție fluidă între text, imagine, sunet și alte modalități, extinzând interfețele conversaționale dincolo de interacțiunea pur textuală. Această integrare permite chatboților AI să analizeze intrările vizuale, să răspundă la conținut multimedia și să genereze răspunsuri cu medii bogate, combinând textul cu elemente vizuale sau auditive. Pentru o privire mai detaliată asupra acestei problematici, puteți consulta analiza agenților AI autonomi și a sistemelor multimodale.

Un aspect paralel este învățarea continuă în timp real, în care arhitecturile avansate își pot actualiza continuu cunoștințele și se pot adapta la informații noi fără a necesita o reantrenare completă. Această abordare abordează o limitare cheie a modelelor statice tradiționale - învechirea rapidă a cunoștințelor în domenii care evoluează dinamic. O abordare arhitecturală emergentă este, de asemenea, ajustarea fină locală (local fine-tuning), care optimizează performanța modelului pentru un context sau utilizator specific, menținând în același timp capacitățile generice ale modelului de bază.

Noua generație de asistenți conversaționali

Efectul cumulativ al acestor inovații arhitecturale este apariția unei noi generații de asistenți conversaționali cu capacități calitativ diferite. Aceste sisteme depășesc paradigma instrumentelor reactive de întrebări și răspunsuri, îndreptându-se către parteneri cognitivi proactivi, capabili de raționament independent, învățare continuă și adaptare la nevoile specifice ale utilizatorilor. Aplicațiile practice includ sisteme educaționale personalizate care adaptează dinamic conținutul și abordarea pedagogică la stilul de învățare al studentului; asistenți de cercetare capabili să formuleze ipoteze și să propună design experimental; sau consilieri strategici care oferă suport substanțial în luarea deciziilor complexe în context de afaceri. Această evoluție reprezintă o schimbare semnificativă către sisteme AI care funcționează ca adevărați amplificatori cognitivi, extinzând exponențial capacitățile cognitive umane.